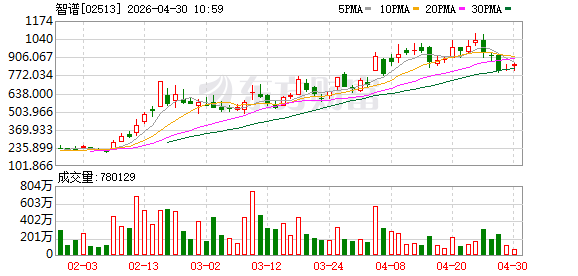

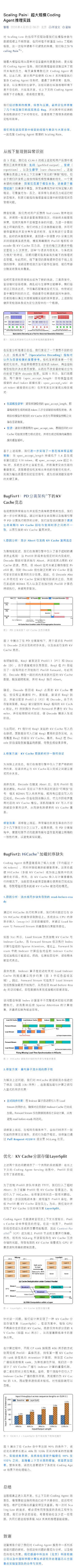

智谱公布GLM-5底层基础设施重大工程进展:系统吞吐量最高提升132% 修复方案获SGLang开源社区采纳

AI导读:

4月30日,北京智谱华章科技股份有限公司(以下简称“智谱”)发布技术报告《ScalingPain:超大规模CodingAgent推理实践》,首次系统披露GLM-5系列模型在超大规模CodingAgent调用场景下的底层推理技术突破。

报告显示

4月30日,北京智谱华章科技股份有限公司(以下简称“智谱”)发布技术报告《ScalingPain:超大规模CodingAgent推理实践》,首次系统披露GLM-5系列模型在超大规模CodingAgent调用场景下的底层推理技术突破。

报告显示,经底层工程优化,GLM-5系列在CodingAgent场景下的系统吞吐量最高提升132%,系统异常输出率从万分之十几下降至万分之三以下。相同硬件条件下服务能力显著扩容。KVcache修复方案获SGLang开源社区采纳,惠及全球基于SGLang部署模型的厂商。

据悉,公司推理优化还在进一步加速,以大幅提升单位算力token吞吐效率,并降低推理成本。

在业内看来,本次披露在三个层面具有资本市场含义。一是直接指向单位推理成本结构改善。系统吞吐量10%-132%的提升意味着相同硬件条件下服务能力的显著扩容,公司推理优化还在进一步加速,对单位Token推理成本与毛利率提升构成直接利好。

二是验证CodingAgent商业化领先地位。GLMCodingPlan发布以来,智谱已成为国内CodingToken调用规模最大的厂商之一,日均数亿次的CodingAgent调用规模为本次工程突破提供了真实负载基础,这也使工程团队得以最先定位并修复CodingAgent时代的底层基础设施问题,产生先发优势。

三是基础设施能力获第三方验证。智谱本次披露的工程突破具备明确的技术深度——团队不仅在自有推理链路中定位并修复了PD分离架构下的KVCache跨节点复用竞态,更进一步在主流开源推理框架SGLang的源代码层面发现并修复了HiCache模块的加载时序缺失问题,修复方案被SGLang开源社区采纳,其底层基础设施能力不仅服务于自身模型,也正在成为大模型行业的公共基础设施之一。

以下为技术报告。

(文章来源:证券日报)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。