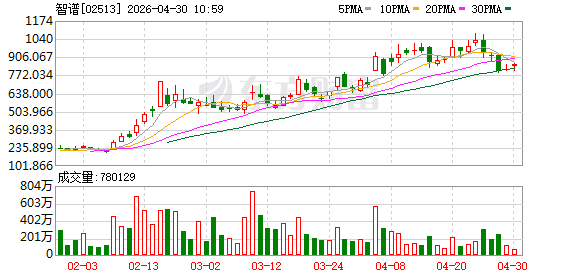

智谱首次发布推理基础设施技术报告 揭秘大模型后台“隐形BUG”

AI导读:

4月30日凌晨,智谱发布技术博客,公布GLM-5底层基础设施重大工程进展:系统吞吐最高提升132%,相同硬件条件下服务能力显著扩容。HiCache修复方案已通过Pull Request #22811提交至SGLang开源社区。

同时,智谱推理优

4月30日凌晨,智谱发布技术博客,公布GLM-5底层基础设施重大工程进展:系统吞吐最高提升132%,相同硬件条件下服务能力显著扩容。HiCache修复方案已通过Pull Request #22811提交至SGLang开源社区。

同时,智谱推理优化还在进一步加速,大幅提升单位算力Token吞吐效率,降低推理成本。

智谱团队坦言:“这些问题在Chat时代根本不存在,只有在Coding&Agent时代、超大规模调用下才会出现。”

这篇技术博客显示,随着大模型从“聊天”转向“干活”,模型需要记住的上下文长度从平均55k Tokens增至70k Tokens以上,日均Token调用量达万亿级别。高频工具调用、长尾提问模式叠加,让Chat时代从未暴露的底层问题在GLM-5系列上第一次显现出来。其中,两个“隐形Bug”浮出水面。

第一个是PD分离下的KV Cache竞态。Decode侧因超时触发Abort并回收KV Cache槽位,但Abort信号未能及时传递到Prefill,导致旧请求残留的RDMA写操作继续落在已被复用的槽位上,覆盖新请求数据。处理上,在Decode与Prefill之间引入显式同步,只有在确认相关RDMA写入尚未开始或已全部完成后,才允许回收槽位。修复后,异常率由约万分之十几下降至万分之三以下。

第二个问题是HiCache的加载时序缺失。在Load Stream与Forward Stream重叠执行的情况下,Indexer算子启动前未等待Indexer Cache加载完成,出现典型的read-before-ready,使用未初始化数据参与计算,进而引发输出异常。智谱的解决方案是在Indexer启动前增加与Load Stream的同步点,确保依赖数据就绪。修复后该类异常不再出现。

与此同时,智谱还进行了一项优化:让“记忆缓存”瘦身,长文本吞吐量翻倍。

在Agent场景下,模型需频繁调用历史记忆。传统做法是每张计算卡保存全部层级的记忆,造成冗余。智谱设计分层存储方案:每张卡只保留部分层,通过广播协同,额外通信开销仅为原来的八分之一。实验显示,在缓存命中率90%的情况下,对40k至120k Tokens长度的请求,系统吞吐量提升10%至132%,上下文越长收益越明显。

此外,在排查过程中,智谱团队还发现了一个意外的洞察:原本用来加速模型生成的“投机采样”技术,其统计指标可以实时反映记忆缓存的健康度。

基于这一洞察,智谱构建了“在线异常监控策略”,并已部署到所有GLM-5系列集群。它能在用户感知到异常之前,实时拦截并重试出问题的请求。原本用来提速的工具,意外变成了守护质量的“监察员”。

目前,这一报告所披露的工程问题在国内大模型行业属于“无人区”,只有日均Token调用进入万亿级、单请求上下文突破70k Tokens、且大规模承载真实Agent负载的厂商,才会触达这类底层竞态问题。当大模型真正开始“干活”,底层的工程能力才是决定谁能跑通的硬指标。

(文章来源:证券时报网)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。