企业AI安全挑战:网络安全就绪指数揭示风险

AI导读:

思科发布的2025年《全球网络安全就绪指数》显示,多数企业面临AI安全风险,92%的中国大陆企业遭遇至少一次AI相关安全事件。企业需加强AI安全防护,应对新型攻击手法。

21世纪经济报道记者肖潇北京报道

从AI聊天机器人到今年爆火的AI智能体,人工智能正被视为提升生产力的关键引擎,迅速融入各类办公场景。但企业真的为此做好准备了吗?思科最新发布的2025年《全球网络安全就绪指数》揭示了现状:或许还未完全就绪。

在企业安全领域,AI的“双刃剑”特性尤为显著。一方面,AI被越来越多地应用于安全防护策略:报告显示,多数国内企业已在安全运营中初步引入AI,超过90%的受访者将生成式AI用于威胁情报收集和威胁检测。

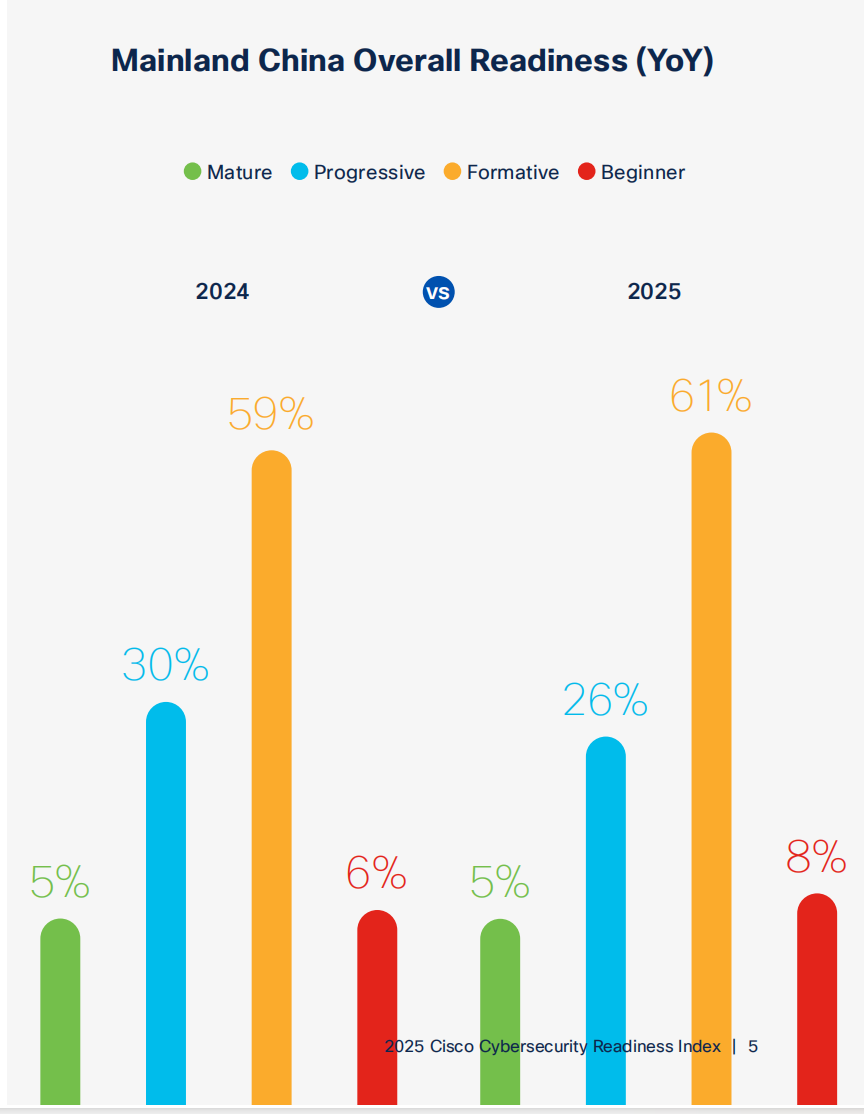

另一方面,企业面临更严峻的AI安全风险。数据显示,全球86%的企业在过去一年中遭遇至少一次AI相关的安全事件,在中国大陆市场,这一比例高达92%。  (中国大陆市场的网络安全就绪指数,今年仅5%的企业达到“成熟”水平|图《全球网络安全就绪指数2025》)

(中国大陆市场的网络安全就绪指数,今年仅5%的企业达到“成熟”水平|图《全球网络安全就绪指数2025》)

《全球网络安全就绪指数》特别指出“员工使用AI”带来的不确定性和监管挑战。近半国内员工使用公司批准的AI工具,但约20%的员工能无限制访问ChatGPT等公网AI工具,而46%的企业对此毫不知情。

工作中使用AI可能无意泄露企业商业机密或用户数据,更严重者,生成内容中可能被嵌入恶意指令。这类员工绕过公司合规体系、自行下载或使用AI工具的行为,被称为“影子AI(Shadow AI)”。

《全球网络安全就绪指数》指出,由于企业安全系统难以覆盖所有AI使用路径,多数安全团队无法追踪员工在生成式AI工具中的输入内容,难以及时发现敏感信息泄露、数据滥用或异常行为,成为企业AI管理的一大盲区。整体来看,仅48%的国内受访者表示能充分理解AI带来的安全威胁。不到一半的企业认为自家安全团队真正了解攻击者如何利用AI发动攻击。

报告发布方思科公司安全事业部总经理卜宪录表示,该报告由第三方进行双盲调查,样本来自全球30个市场、8000多名私营企业的安全负责人,已连续发布三年。

卜宪录指出,近两年来网络安全最大变化之一是生成式AI的迅速普及。员工对AI的认知和理解不足,企业层面仍处于“AI赋能”初级阶段,配套的安全保障能力尚未跟上。

中国市场在AI合规层面不乏法规参照,如《数据安全法》《个人信息保护法》及2023年《生成式人工智能服务暂行管理办法》等。据卜宪录了解,国内企业普遍最关注AI合规性和业务连续性,尤其担忧网络攻击和业务中断的影响。但挑战在于,AI系统分散部署于多个业务部门间,数据链条复杂,加大了统一管理难度。

针对企业如何系统性加强AI安全防护,卜宪录提出“三步走”路线图:第一步是“发现”,明确公司内部网络中存在哪些AI应用,包括员工是否使用未经授权的AI工具;第二步是“检测”,识别AI系统可能存在的漏洞和风险点;第三步是“防护”,构建系统安全机制,重点应对AI带来的新型攻击手法,如提示词攻击、幻觉内容生成、敏感数据在对话中无意泄露等。

(文章来源:21世纪经济报道)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。