抖音详解算法原理与治理体系,加强算法透明度与规范

AI导读:

抖音在北京举办安全与信任中心开放日活动,首次披露平台算法原理、治理体系。通过“人工+机器”协同治理,打破信息茧房,加强内容审核,确保精准研判。中央网信办加强算法全流程监管,推动算法应用生态持续向好。

当算法已经深刻融入日常生活中,平台应当如何管理算法,才能避免其无序发展、走向失控?这是社会各界广泛关注的问题。

4月16日,澎湃新闻记者获悉,近期抖音在北京举办“安全与信任中心开放日”活动,首次对平台算法原理、平台治理体系以及社会关切的问题进行了较为详细的披露。

抖音曾经多次因为算法陷入舆论争议。去年农夫山泉董事长钟睒睒曾喊话字节跳动创始人张一鸣,请求头条和抖音停止对一个中国公民的侵害。对此,抖音副总裁李亮多次在公开平台回应,但始终未正面披露算法机制。

在此次发布会上,抖音算法工程师刘畅介绍,抖音推荐算法作为人工智能机器学习技术的重要应用场景,本质上是一套高效的信息过滤系统。平台推荐系统采取“人工+机器”协同的方式进行风险治理,由人工运营和治理体系为算法导航,同时多目标体系算法主动打破“信息茧房”,为用户带来更丰富的推荐结果。

抖音的推荐算法与国内外大部分内容推荐平台相似,包含召回、过滤、排序等环节,重点是学习用户行为。抖音基于用户行为的推荐方法包含多种技术模型,如协同过滤、双塔召回、Wide&Deep模型等。算法可以在完全“不理解内容”的情况下,找到兴趣相似的用户,推荐相关内容。

目前,抖音算法已几乎不依赖对内容和用户打标签,而是通过神经网络计算,预估用户行为,计算用户观看内容获得的价值总和,把排名靠前的内容推给用户。

针对“信息茧房”问题,抖音算法在多目标建模体系下设置专门的探索维度,通过多样性打散、多兴趣召回、扶持小众兴趣等方法控制相似内容出现的频次,帮助用户探索更多新兴趣。

算法虽能学习、预估用户行为,但因其无法理解内容语义,可能导致违法违规、不良内容被推荐传播。因此,算法在真实使用场景中,必须由平台治理对其进行约束和规范。

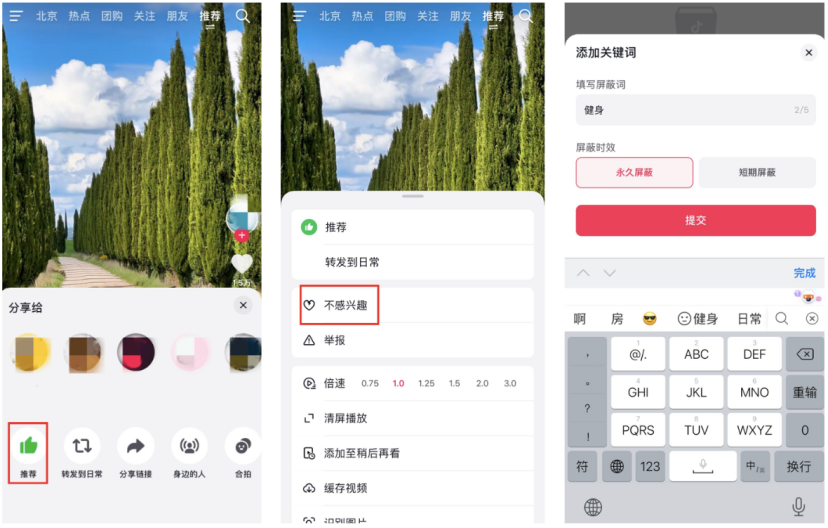

在内容治理方面,抖音采用“人工参与+机器学习”相结合的模式,并组建专门的平台治理团队为算法设置“护栏”。治理流程秉持两大准则:一是所有发布内容都会经过评估,流量越高评估次数越多、标准越严格;二是内容审核采用“人工+机器”模式,确保精准研判。

创作者上传内容后,首先进入机器识别环节。若内容被识别出含有高危特征,将被直接拦截;若模型判断有问题但未命中高危特征,则送至人工审核。视频被举报、评论区出现集中质疑、流量激增等情况,均可能触发“人工+机器”审核。一旦内容在任一环节被处置,系统会立即停止推荐和分发。

抖音还成立数个专项治理团队,针对诈骗、网暴、虚假摆拍、未成年人保护、网络水军、AIGC技术滥用等风险进行治理。例如,上线辟谣卡遏制不实信息传播。此外,抖音安全与信任中心网站正广泛征集意见。

算法治理已成为平台面临的共同问题。中央网信办聚焦算法问题,出台系列政策法规,加强全流程监管,推动算法应用生态持续向好。加强算法治理是维护网络安全和意识形态安全的关键环节,是推动平台经济健康可持续发展的有力保障。

去年11月,中央网信办等部门联合发布《关于开展“清朗·网络平台算法典型问题治理”专项行动的通知》,要求优化算法规则透明度和可解释性,预防和减少争议纠纷。

(文章来源:澎湃新闻)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。