视频生成领域迎开源潮,腾讯阿里等大模型厂商纷纷加入

AI导读:

近期,大模型开源潮从文本模型扩展到视频生成领域,阿里巴巴、腾讯等大模型厂商纷纷开源视频生成模型,推动行业技术进步。在VBench视频生成模型评测榜单上,开源模型已占据重要地位。

大模型开源潮已从文本模型扩展到视频生成领域。2月25日,阿里巴巴率先开源了万相2.1视频生成模型,随后3月6日,腾讯紧跟步伐,开源了其图生视频模型。同时,阶跃星辰也计划在本月内开源其图生视频模型,标志着视频生成技术的进一步开放。

据腾讯官方介绍,新开源的图生视频模型拥有130亿参数,适用于写实视频制作、动漫角色生成等多个领域,开源内容包括权重、推理代码和LoRA训练代码。用户仅需上传一张图片,并简要描述画面运动和镜头调度,即可生成5秒短视频。此外,用户还能通过输入文字或音频,让图片中的人物对口型说话或唱歌。

腾讯展示的视频生成案例包括爱因斯坦吃苹果、梵高喝红酒等,从演示视频来看,主体运动流畅,对口型效果逼真。

2月,阿里巴巴开源的万相2.1视频生成模型提供14B和1.3B两种参数规格,支持无限长1080P视频的高效编解码,并首次实现了中文文字视频生成功能。

谈及视频生成的成熟度和开源的意义,腾讯混元多模态生成技术负责人凯撒曾表示,当前视频生成开源生态尚不成熟,主要原因是开源的视频生成底模与闭源存在较大差距。视频生成所需的算力和数据消耗量远超图像生成,因此业内不愿将高成本模型开源。然而,闭门造车导致许多人无法接触到最优模型,因此混元在去年12月决定开源文生视频模型。

业内人士指出,视频生成模型的技术路径仍在探索中,开源有助于推动行业进步。

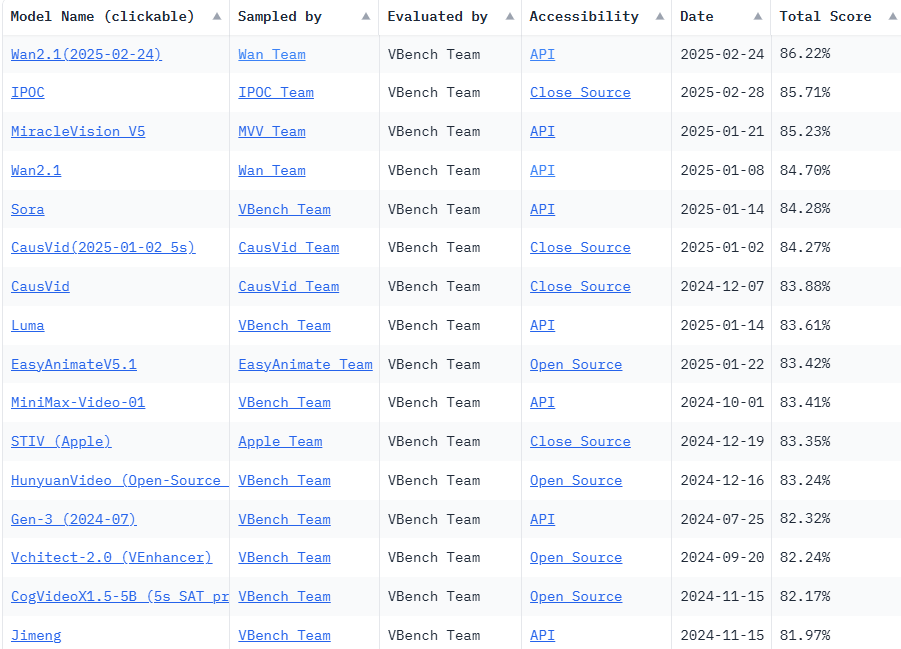

随着多家大模型厂商推动开源,视频生成大模型中,开源模型已占据重要地位。在VBench视频生成模型评测榜单上,万相2.1模型位列第一,总分86.22%,超越闭源的Sora。前20名中,另有6款模型为开源模型。腾讯推出的HunyuanVideo位列第12位,智谱旗下的CogVideoX1.5-5B位列第15位,均为开源模型。在榜单第20名至第50名中,开源模型数量远超闭源模型。

图像生成模型作为图生视频模型的基础,香港大学经管学院发布了《人工智能模型图像生成能力综合评测报告》。在新图像生成内容质量方面,字节即梦AI位居榜首,前20名内包括DALL-E3、Hunyuan-DiT等多个开源模型。

(文章来源:第一财经)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。