DeepSeek-V4官宣时的这行小字,藏着关键细节

AI导读:

字越小,事越大。

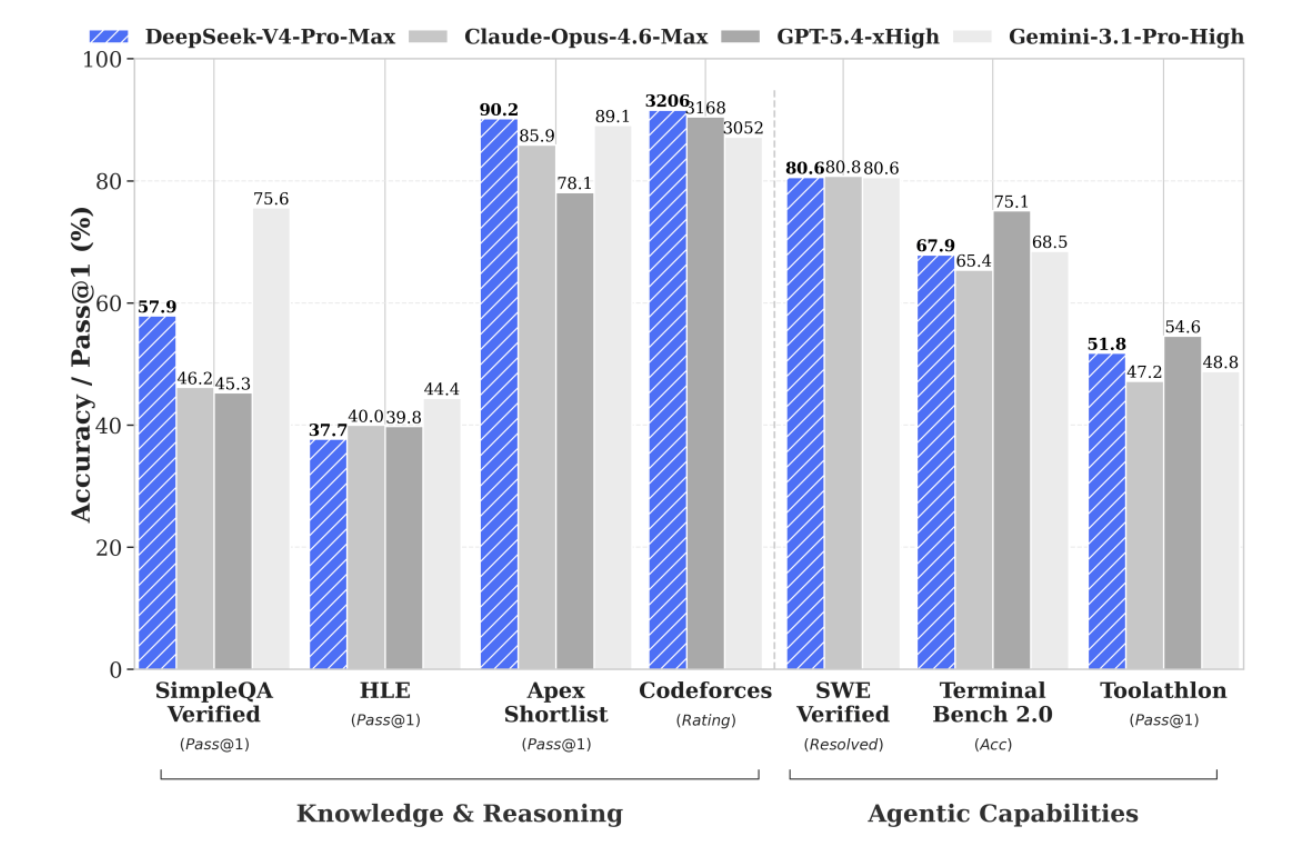

4月24日,DeepSeek-V4发布,官宣文章中一行不起眼的小字,多数人一眼划过,背后却藏着关键细节。

图片来源:DeepSeek微信公众号

芯模联动

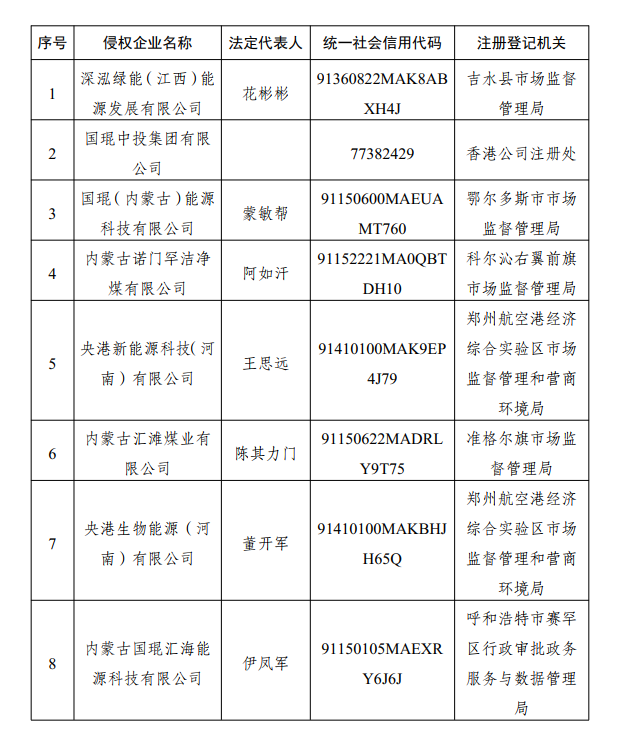

在介绍DeepSeek-V4两个版本的API调用价格时候,图片下

字越小,事越大。

4月24日,DeepSeek-V4发布,官宣文章中一行不起眼的小字,多数人一眼划过,背后却藏着关键细节。

图片来源:DeepSeek微信公众号

芯模联动

在介绍DeepSeek-V4两个版本的API调用价格时候,图片下方注释小字显示:受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格会大幅下调。

这张图至少包含了两方面信息:

一方面,这个定价现在已经比国外对标模型便宜很多,但是下半年价格还会继续下探。以每百万Tokens计,DeepSeek-V4-Flash版输入(缓存命中)0.2元,输入(缓存未命中)1元,输出2元;DeepSeek-V4-Pro版输入(缓存命中)为1元,输入(缓存未命中)12元,输出24元。

对比Claude Opus4.6,以每百万Tokens计,缓存命中的输入单价为0.5美元,缓存未命中的输入单价为5美元,输出单价为25美元。按4月24日当日汇率计算,DeepSeek-V4-Pro的三项定价,分别是Opus 4.6的29%、35%和14%。

另一方面,价格下调和昇腾950超节点批量上市同步。业内认为,这显示出DeepSeek-V4或与国产算力芯片做针对性的深度联动适配。

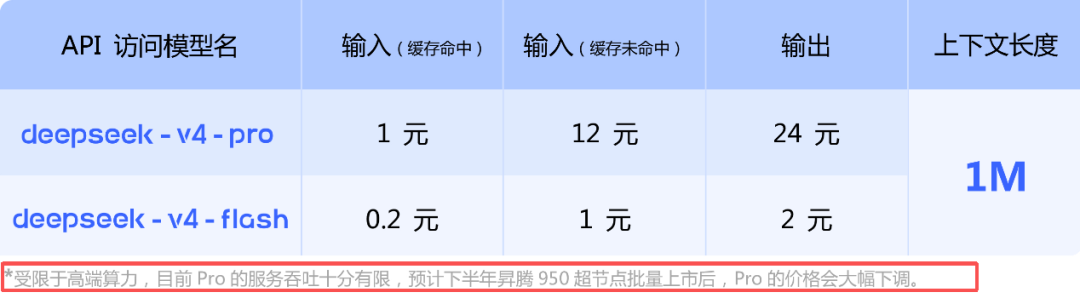

DeepSeek-V4公开的技术报告也说明了这一点。该报告显示,DeepSeek-V4将细粒度专家并行(EP)方案同时在英伟达GPU和华为昇腾NPU上完成验证。业内认为,这说明DeepSeek-V4在设计之初便已将兼容多个硬件体系平台纳入技术规划。

图片来源:DeepSeek-V4技术报告

业内认为,结合高端算力芯片供给受限的背景,DeepSeek和华为昇腾芯片联手开辟新路径足以振奋人心,这意味着在国产算力生态上也可以孕育全球领先的模型能力。多位业内专家和投资人也告诉记者,国产算力生态发展一直任重道远,这是一个重要的里程碑。

市场情绪则更加高涨。4月24日,海光信息、摩尔线程、沐曦股份、中芯国际、华虹半导体等A股和H股的国产芯片公司股价全面大涨。

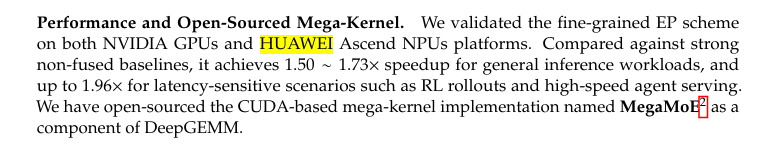

硬件适配

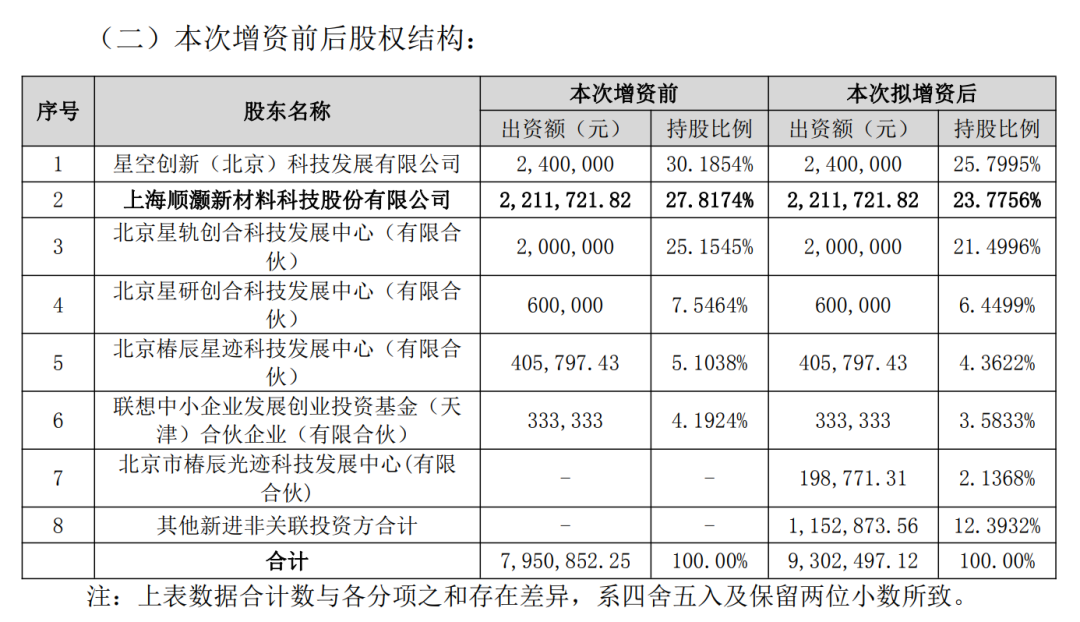

4月24日,华为微信公众号宣布,通过双方芯模技术紧密协同,实现昇腾超节点全系列产品支持DeepSeek-V4系列模型。

图片来源:华为微信公众号

华为表示,昇腾950通过融合kernel和多流并行技术降低Attention计算和访存开销,大幅提升推理性能,结合多种量化算法,实现了高吞吐、低时延的DeepSeek-V4系列模型推理部署。具体来看,基于DeepSeek-V4-Pro模型,在8K输入场景,昇腾950超节点可实现TPOT约20ms时单卡Decode吞吐4700TPS,基于DeepSeek-V4-Flash模型,8K长序列输入场景下可实现TPOT约10ms时单卡Decode吞吐1600TPS。

除了昇腾950,华为也宣布,昇腾A2、A3系列产品也适配DeepSeek-V4-Flash、DeepSeek-V4-Pro。

华为昇腾芯片在持续迭代演进。华为轮值董事长徐直军2025年9月在公开演讲时表示,华为昇腾芯片已经规划到2028年。

徐直军表示,昇腾芯片是华为AI算力战略的基础。华为2018年发布的昇腾310芯片,是昇腾系列芯片首款产品。2019年发布昇腾910芯片。2025年,昇腾910C芯片随着昇腾900超节点规模部署,逐渐为外界所熟悉。“我们将以几乎一年一代、算力翻倍的速度,同时围绕更易用、更多数据格式、更高带宽等方向持续演进,持续满足AI算力不断增长的需求。”徐直军说。

软件生态

除了硬件之外,AI系统和软件生态的竞争也值得关注。

长期以来,全球AI算力体系几乎围绕英伟达的CUDA生态开展。这一次,国产算力芯片在软件生态上也留下了清晰的成长印记。

4月24日下午,华为在多个账号进行DeepSeek-V4昇腾首发的直播,讲解基于CANN的训推优化实践。作为昇腾AI生态的根基和锚点,华为昇腾芯片异构计算架构CANN框架已经迭代到8.0版本。

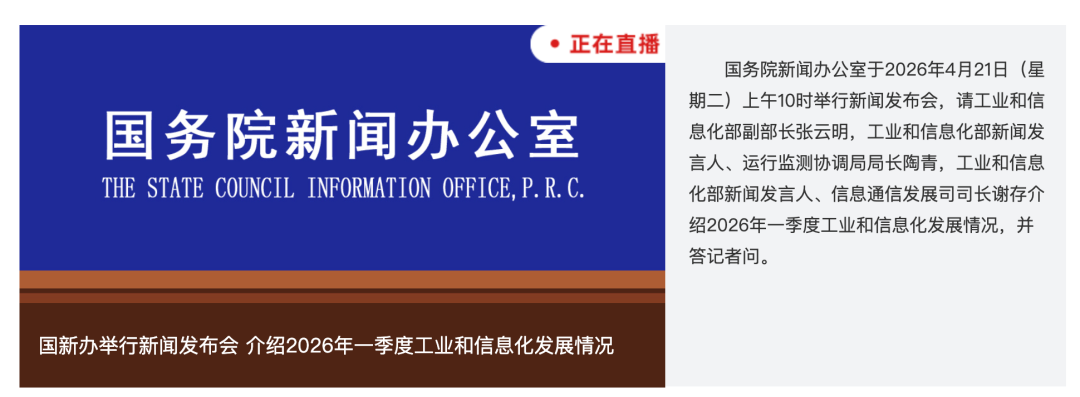

除了华为,4月24日,寒武纪宣布,已基于vLLM推理框架完成对DeepSeek两款最新开源模型的Day0适配。寒武纪特别强调,这一成果得益于寒武纪长期积累的自研NeuWare软件生态与芯片设计技术。在软件生态层面,寒武纪NeuWare软件栈全面拥抱开源社区,原生支持PyTorch、vLLM、Diffusers等主流AI框架,新模型可快速迁移至寒武纪平台;在国产软件生态层面,寒武纪与众智FlagOS生态持续深度合作,解耦模型与不同架构芯片之间的生态壁垒,进一步降低模型适配迁移成本。

图片来源:寒武纪开发者微信公众号

为了解决不同国产芯片接口、软件生态互不兼容的问题,北京智源研究院此前牵头推出面向多种AI芯片的统一开源系统软件栈——众智FlagOS。4月24日,众智FlagOS宣布,对DeepSeek-V4两个模型进行全量适配,已经完成DeepSeek-V4-Flash在8款以上AI芯片上的全量适配与推理部署,包括海光、沐曦、华为昇腾、摩尔线程(FP8)、昆仑芯、平头哥真武、天数、英伟达(FP8)等,同时正在推进DeepSeek-V4-Pro模型在多个芯片的迁移适配,后续即将开源。

智源研究院还表示,通过多项技术突破,使得DeepSeek-V4能够在当前各种厂商的主流AI芯片上稳定运行,而非仅限于支持FP4和大显存的少数高端AI加速卡;FlagOS的核心算子库FlagGems全量支持DeepSeek-V4算子,一是彻底脱离CUDA算子依赖,二是无需芯片厂商逐一适配,三是新算子即时可用。

一位业内专家告诉记者,越来越多国产模型企业已把国产算力的部署适配放到更突出位置。从现实约束看,模型训练、推理框架、芯片算子、通信库和云平台调度任何一环跟不上,都会削弱国产模型的成本优势。

(文章来源:中国证券报)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。