当Day-0适配已成“习惯”,国产算力正形成“速度与高效”

AI导读:

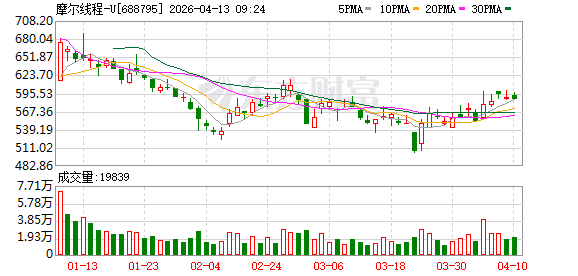

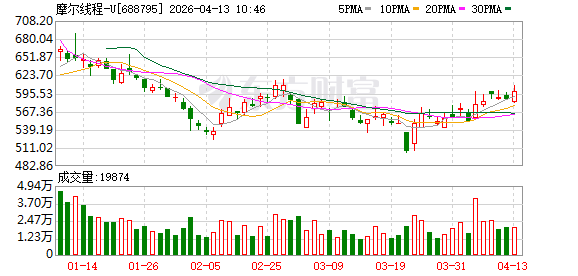

4月12日晚,摩尔线程宣布,旗舰级AI训推一体全功能GPU MTT S5000已完成对新一代大模型MiniMax M2.7的Day-0极速适配,再次验证了国产全功能GPU对前沿AI大模型的快速响应与稳定支撑能力。

MiniMax M2.7是具备深度

4月12日晚,摩尔线程宣布,旗舰级AI训推一体全功能GPU MTT S5000已完成对新一代大模型MiniMax M2.7的Day-0极速适配,再次验证了国产全功能GPU对前沿AI大模型的快速响应与稳定支撑能力。

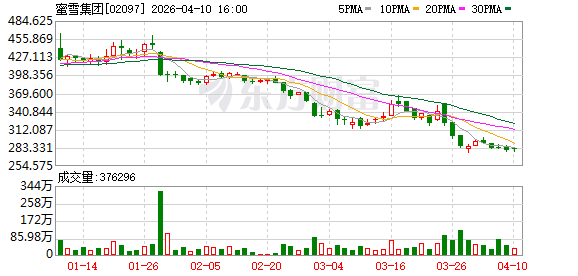

MiniMax M2.7是具备深度自我进化能力的大模型,能够自主构建Agent Harness,通过Agent Teams协作、复杂Skills调用及Tool Search Tool等能力完成复杂生产力任务,甚至深度参与自身迭代。在软件工程领域,M2.7支持端到端完整项目交付、日志分析排障、代码安全审查及机器学习任务;在专业办公场景,其Excel/PPT/Word高保真编辑与多轮修改能力显著提升,即使在超长上下文复杂任务中仍保持稳定的高水平skills遵循率。与此同时,该模型对长上下文处理、复杂Agent任务调度及高保真编辑等场景提出了极高的计算效率要求。

针对这些挑战,摩尔线程技术团队基于MUSA架构完成深度调优,成功在MTT S5000上实现M2.7大模型的高性能推理,实现了“超长上下文高吞吐”“全精度端到端支持”“高算力低延迟推理”等优势。其中,依托MTT S5000的80GB大容量显存、1.6TB/s高带宽及PD分离架构,配合高效KV Cache管理,可支撑MiniMax M2.7长时间、多步骤任务的稳定执行。MTT S5000单卡可提供1000 TFLOPS稠密算力,结合vLLM-MUSA定制化调优,实现复杂Agent Harness与高频工具调用场景下的低延迟响应。

观察:国产全功能GPU算力底座更“速度与高效”

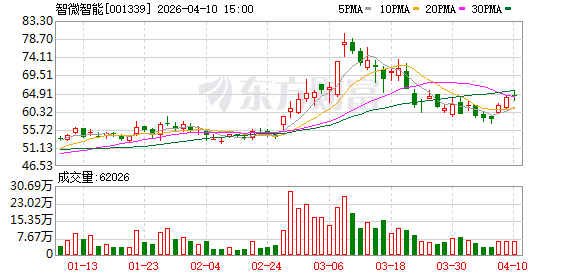

此次Day-0适配,是摩尔线程常态化技术响应能力的再次体现。今年以来,摩尔线程已先后实现了对智谱GLM-5、MiniMax M2.5、智谱GLM-5.1等大模型的Day-0适配。

这种快速响应能力的背后,是摩尔线程MUSA 架构的强大生态兼容性——其已深度兼容PyTorch、vLLM、SGLang、Triton等主流生态,通过MUSA C++、Triton-MUSA、TileLang-MUSA等抽象层实现新算子“零成本迁移”,确保前沿模型发布当日完成极速适配,进一步加速大模型创新落地与规模化应用。

当Day-0适配已成“习惯”,标志着国产全功能GPU算力底座正逐渐形成覆盖前沿模型“极速适配-高效部署”的全链路支撑体系,帮助开发者以更快响应、更稳运行、更低迁移成本第一时间接入最新模型能力。

(文章来源:广州日报)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。